Точно так же, как гражданский мир становится свидетелем быстрого прогресса в развитии и распространении искусственного интеллекта (ИИ), военный мир также должен готовиться к натиску инноваций. В той же мере, в какой он меняет характер войны, он также может оказаться дестабилизирующей.

The Economist в номере за 22 июня 2024 года вынес на обложку рисунок «Война и ИИ».

I. В статье «Искусственный интеллект изменит характер войны» эксперты журнала пишут:

«Сегодняшние стремительные перемены имеют несколько причин.

Во-первых, это горнило самой войны, особенно на Украине. Небольшие, недорогие чипы регулярно направляют российские и украинские беспилотники к целям, расширяя технологию, которая когда-то была доступна только в ракетах сверхдержавы.

Во-вторых, это недавний экспоненциальный прогресс ИИ, позволяющий распознавать объекты и решать задачи более высокого порядка.

В-третьих, это соперничество между Америкой и Китаем, в котором обе стороны видят в ИИ ключ к военному превосходству.

Результаты наиболее заметны в развитии интеллектуальных машин для убийства. Воздушные и морские беспилотники были жизненно важны для обеих сторон на Украине для обнаружения и атаки целей. Роль искусственного интеллекта заключается в том, чтобы решить проблему глушения, потому что он позволяет дрону наводиться на цели, даже если сигналы GPS или связь с пилотом были прерваны. Разрыв связи между пилотом и самолетом вскоре позволит армиям развернуть гораздо большее количество недорогих боеприпасов. В конце концов, самонаводящиеся рои будут созданы для того, чтобы разрушить оборону.

Но самое заметное в военном ИИ — это не самое важное. Эта технология также революционизирует командование и управление, которые военные офицеры используют для организации войн.

На линии фронта дроны олицетворяют собой как раз последнее и самое драматичное звено в цепи убийства, серию шагов, начинающихся с поиска цели и заканчивающихся атакой. Более глубокое значение ИИ заключается в том, что он может сделать до того, как дрон нанесет удар. Поскольку он сортирует и обрабатывает данные со сверхчеловеческой скоростью, он может вытащить каждый танк из тысячи спутниковых снимков или интерпретировать свет, тепло, звук и радиоволны, чтобы отличить ложные цели от настоящих.

Вдали от линии фронта он может решать гораздо более масштабные задачи, чем те, с которыми сталкивается один беспилотник. Сегодня это означает простые задачи, такие как определение того, какое оружие лучше всего подходит для уничтожения угрозы. Со временем «системы поддержки принятия решений» смогут быстро и на обширной территории осознать непостижимую сложность войны — возможно, на всем поле боя.

Последствия этого только сейчас становятся очевидными. Системы искусственного интеллекта в сочетании с автономными роботами на суше, на море и в воздухе, вероятно, будут находить и уничтожать цели с беспрецедентной скоростью и в огромных масштабах.

Скорость такой войны изменит баланс между солдатом и программным обеспечением. Сегодня армии держат человека «в курсе», одобряя каждое летальное решение. Поскольку поиск и нанесение ударов по целям сжаты минутами или секундами, человек может просто «сидеть в петле», как часть команды человек-машина. Люди будут следить за системой, не вмешиваясь в каждое действие.

Парадокс заключается в том, что, несмотря на то, что ИИ дает более четкое представление о поле боя, война рискует стать более непрозрачной для людей, которые в ней участвуют. Времени на то, чтобы остановиться и подумать, будет меньше. По мере того, как модели выносят все более оракуловские суждения, их результаты будет становиться все труднее тщательно изучать, не уступая врагу смертельного преимущества. Армии будут опасаться, что если они не дадут своим советникам ИИ более длинный поводок, они будут побеждены противником, который это сделает. Более быстрые бои и меньшее количество пауз затруднят переговоры о перемирии или остановку эскалации. Это может сыграть на руку обороняющимся, которые могут затаиться, пока атакующие выходят из укрытия при продвижении. Или же это может подтолкнуть атакующих к упреждающему удару с применением массированной силы, чтобы разрушить датчики и сети, от которых будут зависеть армии с поддержкой ИИ.

Масштабы войн, основанных на ИИ, означают, что массовый и промышленный вес, вероятно, станет еще более важным, чем сегодня. Вы можете подумать, что новые технологии позволят армиям стать более компактными. Но если программное обеспечение сможет распознавать десятки тысяч целей, армиям понадобятся десятки тысяч единиц оружия, чтобы нанести по ним удар. А если обороняющийся будет иметь преимущество, атакующим потребуется больше оружия для прорыва.

Это не единственная причина, по которой война ИИ благоприятствует большим странам. Беспилотные летательные аппараты могут стать дешевле, но цифровые системы, которые объединяют поле боя, будут дьявольски дорогими. Создание армий с ИИ потребует огромных инвестиций в облачные серверы, способные обрабатывать секретные данные. Армии, флоты и военно-воздушные силы, которые сегодня существуют в своих собственных хранилищах данных, должны быть интегрированы. Обучение моделей потребует доступа к огромному массиву данных».

Какой большой стране ИИ отдает предпочтение больше всего? Когда-то считалось, что у Китая есть преимущество, благодаря его пулу данных, контролю над частным бизнесом и более мягким этическим ограничениям. Тем не менее, по мнению экспертов The Economist, «сейчас Америка, похоже, находится впереди в передовых моделях, которые могут сформировать следующее поколение военного ИИ. И идеология имеет значение: неясно, смогут ли армии авторитарных государств, которые ценят централизованный контроль, воспользоваться преимуществами технологии, которая выводит интеллект и проницательность на самый низкий тактический уровень».

«Если, к сожалению, разразится первая война с использованием ИИ, международное право, скорее всего, будет вытеснено на обочину. Тем больше поводов задуматься сегодня о том, как ограничить разрушения. Например, Китаю следует прислушаться к призыву Америки исключить контроль ИИ над ядерным оружием. И как только начнется война, горячие линии между людьми станут более важными, чем когда-либо. Системы ИИ, призванные максимизировать военное преимущество, должны быть закодированы с помощью ценностей и ограничений, которые человеческие командиры воспринимают как должное. Они включают в себя неявную ценность человеческой жизни (сколько гражданских лиц допустимо убить при преследовании важной цели?) и избегание определенных дестабилизирующих ударов, таких как по ядерным спутникам раннего предупреждения.

Неопределенность огромна. Единственное, в чем можно быть уверенным, так это в том, что изменения, управляемые искусственным интеллектом, приближаются.

Скорее всего, победят те армии, которые первыми и наиболее эффективными овладеют технологическими достижениями. Все остальные, скорее всего, станут жертвами».

II. В другой статье в том же номере The Economist «Как ИИ меняет войну. Генеральный штаб с искусственным интеллектом может быть важнее, чем роботы-убийцы» отмечается:

«В конце 2021 года Королевский военно-морской флот Великобритании обратился к Microsoft и Amazon Web Services, паре американских технологических гигантов, с вопросом: есть ли лучший способ вести войну? В частности, могут ли они найти более эффективный способ координации между гипотетической ударной группой коммандос в Карибском море и ракетными системами фрегата? Технологические фирмы сотрудничали с BAE Systems, гигантским производителем оружия, и Anduril, небольшой компанией, а также с другими военными подрядчиками. В течение 12 недель — непостижимо быстро в мире оборонных закупок — консорциум собрался в британском графстве Сомерсет для демонстрации того, что было названо StormCloud.

Морские пехотинцы на земле, беспилотные летательные аппараты в воздухе и многие другие датчики были соединены через «ячеистую» сеть передовых радиостанций, которые позволяли каждому из них беспрепятственно видеть, что происходит в другом месте — установка, которая уже позволяла морским пехотинцам наматывать круги вокруг гораздо более крупных сил на предыдущих учениях. Данные, которые они собирали, обрабатывались как на «периферии» сети, на борту небольших, прочных компьютеров, прикрепленных к машинам коммандос с помощью банджи-кабелей, так и на удаленных облачных серверах, куда они были отправлены со спутника. Командно-контрольное программное обеспечение осуществляло мониторинг заданного района, решало, какие беспилотники куда должны лететь, идентифицировало объекты на земле и предлагало, каким оружием ударить по какой цели.

Результаты оказались впечатляющими. Было очевидно, что StormCloud был «самой продвинутой цепочкой убийств в мире», говорит офицер, участвовавший в эксперименте, имея в виду сеть датчиков (таких как дроны) и оружия (например, ракет), связанных вместе с цифровыми сетями и программным обеспечением, чтобы понять данные, передаваемые туда и обратно. Еще два года назад, по его словам, он был «на много миль впереди» с точки зрения скорости и надежности офицеров-людей в обычном штабе.

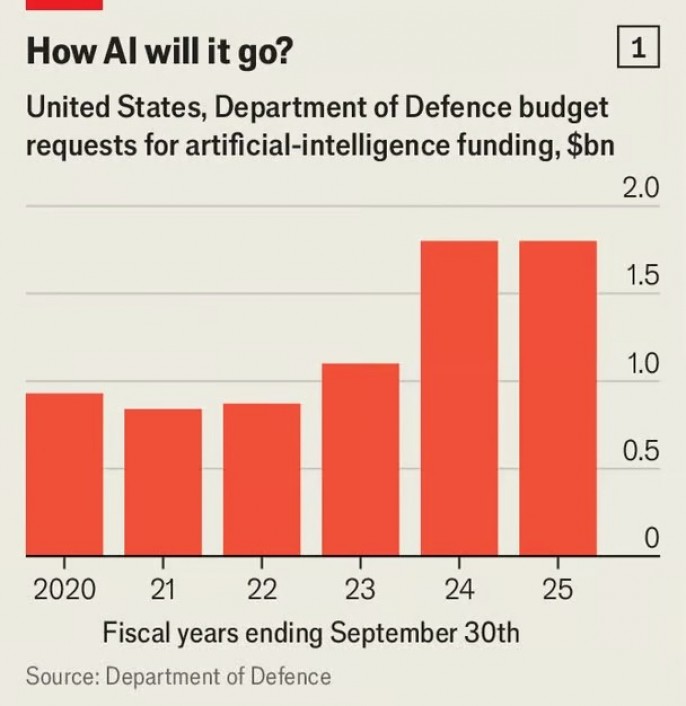

Инструменты и оружие с поддержкой ИИ используются не только на учениях. Они также используются во все более широких масштабах в таких местах, как Газа и Украина. Вооруженные силы боятся, что их оставят позади их противники. Расходы быстро растут (см. график 1). Но юристы и специалисты по этике опасаются, что ИИ сделает войну более быстрой, непрозрачной и менее гуманной. Разрыв между двумя группами становится все большим, даже несмотря на то, что перспектива войны между великими державами становится также все большим.

Единого определения ИИ не существует. Вещи, которые когда-то заслуживали этого термина, такие как навигация по местности ракет «Томагавк» в 1980-х годах или способность ракет Brimstone обнаруживать танки в начале 2000-х годов, теперь рассматриваются как повседневное программное обеспечение. И многие передовые возможности, описываемые как ИИ, не включают в себя «глубокое обучение» и большие языковые модели, лежащие в основе таких сервисов, как Chatgpt. Но в разных обличьях ИИ проникает во все аспекты войны».

«Это начинается со скучных вещей: техническое обслуживание, логистика, персонал и другие задачи, необходимые для того, чтобы армии были укомплектованы, накормлены и заправлены. Недавнее исследование, проведенное аналитическим центром Rand Corporation, показало, что ИИ, предсказывая, когда потребуется техническое обслуживание боевых самолетов А-10 c, может сэкономить ВВС США 25 миллионов долларов в месяц, избегая поломок и затоваривания запчастей (хотя ИИ хуже справляется с деталями, которые редко выходят из строя).

Еще одно перспективное направление – логистика. Например, армия США использует алгоритмы, чтобы предсказать, когда украинским гаубицам понадобятся новые стволы. ИИ также начинает просачиваться в HR. Армия использует модель, обученную на 140 000 личных дел, чтобы помочь набрать солдат для продвижения по службе.

Другая крайность – это острый конец вещей. И Россия, и Украина спешно разрабатывают программное обеспечение, позволяющее беспилотникам самостоятельно перемещаться к цели и наводиться на нее, даже если помехи нарушают связь между пилотом и беспилотником. Обе стороны обычно используют для этой цели небольшие чипы, которые могут стоить всего 100 долларов. На видео ударов беспилотников на Украине все чаще видны «ограничивающие прямоугольники», появляющиеся вокруг объектов, что говорит о том, что беспилотник идентифицирует цель и наводится на нее. Технология остается незрелой, а алгоритмы наведения сталкиваются со многими из тех же проблем, с которыми сталкиваются беспилотные автомобили, такими как загроможденная среда и затененные объекты, а также с некоторыми уникальными для поля боя, такими как дым и ложные цели. Но она быстро улучшается.

Между ИИ в серверной части и ИИ внутри боеприпасов лежит обширное царство инноваций, экспериментов и технологических достижений. Беспилотные летательные аппараты сами по себе лишь разрушают, а не трансформируют войну, утверждают Клинт Хинот, генерал американских ВВС в отставке, и Мик Райан, австралийский генерал в отставке. Но в сочетании с «цифровыми системами командования и контроля» (например, StormCloud) и «ячеистыми сетями новой эры гражданских и военных датчиков», результатом, по их словам, является «преобразующая троица», которая позволяет солдатам на передовой видеть и действовать в режиме реального времени на основе информации, которая когда-то была бы ограничена удаленным штабом. Обязательным условием для этого является ИИ.

Начните с сетки датчиков. Представьте себе данные с беспилотников, спутников, социальных сетей и других источников, циркулирующих по военной сети. Слишком много приходится обрабатывать вручную. Тамир Хайман, генерал, возглавлявший израильскую военную разведку до 2021 года, указывает на два больших прорыва. «Фундаментальный скачок», по его словам, восемь или девять лет назад произошел в программном обеспечении для преобразования речи в текст, которое позволяло искать ключевые слова при перехвате голоса. Другая была связана с компьютерным зрением. Проект Spotter в министерстве обороны Великобритании уже использует нейронные сети для «автоматического обнаружения и идентификации объектов» на спутниковых снимках, что позволяет «автоматически отслеживать места 24 часа в сутки 7 дней в неделю на предмет изменений активности». По состоянию на февраль 2024 года частная компания пометила 25 000 объектов для обучения модели.

Британский генерал Том Копинджер-Саймс заявил в Палате лордов в 2023 году, что такие системы «все еще находятся на верхних границах исследований и разработок, а не в полномасштабном развертывании», хотя он указал на использование коммерческих инструментов для идентификации, например, скоплений гражданских лиц во время эвакуации Великобританией своих граждан из Судана в начале 2023 года. Америка, кажется, продвинулась дальше. В 2017 году компания запустила проект Maven, чтобы справиться с потоком фотографий и видео, снятых беспилотниками в Афганистане и Ираке.

Maven «уже производит большие объемы систем компьютерного зрения для нужд военных», отметил в мае директор Национального агентства геопространственной разведки, которое руководит проектом. Заявленная цель состоит в том, чтобы Maven «соответствовал или превосходил производительность обнаружения, классификации и отслеживания человека». Его пока нет — он борется со сложными случаями, такими как частично скрытое оружие».

«ИИ может обрабатывать не только телефонные звонки или фотографии. В марте 2024 года Королевский военно-морской флот объявил, что его подразделение по поиску мин завершило годичные эксперименты в Персидском заливе с использованием небольшого беспилотного катера Harrier, чья буксируемая гидроакустическая система может искать мины на морском дне и предупреждать другие корабли или подразделения на суше. А Майкл Горовиц, представитель Пентагона, недавно сообщил веб-сайту Defense News, что Америка, Австралия и Великобритания в рамках своего пакта AUKUS разработали «трехсторонний алгоритм», который может быть использован для обработки акустических данных, собранных гидроакустическими буями, сбрасываемыми с самолетов P-8, охотящихся за подводными лодками.

В большинстве этих случаев ИИ идентифицирует сигнал среди шума или объект среди беспорядка: грузовик это или танк? Якорь или мина? Траулер или подводная лодка?

Идентификация людей-комбатантов, возможно, более сложна и, безусловно, более спорна. В апреле 2024 года израильское издание +972 Magazine заявило, что Армия обороны Израиля (ЦАХАЛ) использует инструмент искусственного интеллекта, известный как Lavender, для идентификации тысяч палестинцев в качестве целей, при этом операторы-люди лишь бегло изучают выходные данные системы, прежде чем отдать приказ о нанесении ударов. в ЦАХАЛе возразили, что Lavender — это «просто база данных, целью которой является перекрестное соотнесение разведывательных источников».

На практике Lavender, скорее всего, станет тем, что эксперты называют системой поддержки принятия решений (DSS), инструментом для объединения различных данных, таких как записи телефонных разговоров, спутниковые снимки и другие разведданные. Использование Америкой компьютерных систем для обработки акустических и запаховых данных от датчиков во Вьетнаме можно считать примитивным DSS. Руперт Барретт-Тейлор из Института Алана Тьюринга в Лондоне отмечает, что то же самое можно сказать и о программном обеспечении, используемом американскими шпионами и спецназом в войне с терроризмом, которое превращает записи телефонных разговоров и другие данные в огромные паутинные диаграммы, визуализирующие связи между людьми и местами, с целью выявления повстанцев или террористов.

Отличие заключается в том, что сегодняшнее программное обеспечение выигрывает от большей вычислительной мощности, более быстрых алгоритмов (прорыв в нейронных сетях произошел только в 2012 году) и большего объема данных благодаря распространению датчиков. Результатом является не просто увеличение или улучшение интеллекта. Это размывание грани между разведкой, наблюдением и рекогносцировкой (ISR) и командованием и управлением (C2) — между осмыслением данных и действиями на их основе.

Возьмем, к примеру, украинское программное обеспечение ГИС «Арта», которое сопоставляет данные о российских целях, как правило, для артиллерийских батарей. Оно уже может генерировать списки потенциальных целей «в соответствии с приоритетами командира», пишут генералы Хинот и Райан. По словам официальных лиц, одна из причин, по которой российские целеуказания на Украину в последние месяцы улучшились, заключается в том, что российские системы С2 стали лучше обрабатывать информацию с беспилотников и отправлять ее в пушки. «По некоторым оценкам, — пишет Артур Холланд Мишель в докладе для гуманитарной организации Международного Комитета Красного Креста (МККК), — поиск, распознавание и анализ целей, которые раньше занимали несколько часов, можно сократить… до минут».

Военно-воздушные силы США недавно обратились в корпорацию RAND с просьбой оценить, могут ли инструменты ИИ предоставить варианты «космическому истребителю», имеющему дело с приближающейся угрозой для спутника. Вывод заключался в том, что ИИ действительно может рекомендовать «высококачественные» ответы. Точно так же DARPA, исследовательское подразделение Пентагона, работает над программой, названной «Механизм стратегического хаоса для планирования, тактики, экспериментирования и устойчивости» (Strategic Chaos Engine for Planning, Tactics, Experimentation and Resiliability, SCEPTER) — для выработки рекомендаций по действиям для командиров во время «военных столкновений на высоких скоростях машин». По сути, он может генерировать новые военные планы на лету.

«Многие методы, которые используются» в SCEPTR и подобных проектах DARPA, «не существовали даже два-пять лет назад», говорит Эрик Дэвис, руководитель программы в агентстве. В качестве примера он приводит «теорию операторов Купмана», старую и малоизвестную математическую структуру, которая может быть использована для анализа сложных и нелинейных систем, подобных тем, которые встречаются на войне, в терминах более простой линейной алгебры. Недавние прорывы в его применении сделали ряд проблем ИИ более решаемыми.

Результатом всего этого является растущая интеллектуальная пропасть между теми, чья работа состоит в том, чтобы вести войну, и теми, кто стремится ее укротить. Юристы и специалисты по этике утверждают, что растущая роль ИИ в войне таит в себе опасность. «Системы, которые мы имеем сейчас, не могут распознать враждебные намерения», — утверждает Ноам Лабелл из Университета Эссекса. «Они не могут отличить невысокого солдата с настоящим пистолетом от ребенка с игрушечным пистолетом… или между раненым солдатом, лежащим над винтовкой, и снайпером, готовым стрелять из снайперской винтовки». Такие алгоритмы «не могут быть использованы на законных основаниях», заключает он. Нейронные сети также можно слишком легко обмануть, говорит Стюарт Рассел, специалист по информатике: «Затем вы можете взять совершенно невинные объекты, такие как фонарные столбы, и напечатать на них узоры, которые убедят оружие в том, что это танк».

Сторонники военного ИИ возражают, что у скептиков слишком радужный взгляд на войну. Ударный беспилотник, охотящийся за конкретным объектом, может быть не в состоянии распознать, не говоря уже о том, чтобы уважать попытку капитуляции, признает бывший британский офицер, занимающийся политикой в области ИИ. Но если альтернативой является интенсивный артиллерийский огонь, «в этих обстоятельствах все равно нельзя сдаться». Кит Дир, бывший офицер Королевских военно-воздушных сил, который сейчас работает в японской фирме Fujitsu, идет еще дальше. «Если… Машины производят более низкий уровень ложноположительных и ложноотрицательных результатов, чем люди, особенно под давлением, было бы неэтично не делегировать полномочия», — утверждает он. «Мы проводили различные виды тестов, в которых сравнивали возможности и достижения машины и сравнивали с возможностями человека», — говорит генерал ЦАХАЛа Хейман. «Большинство тестов показывают, что машина гораздо, гораздо, намного точнее… В большинстве случаев это не идет ни в какое сравнение».

Одно из заблуждений заключается в экстраполяции антитеррористических кампаний 2000-х годов. «Будущее не за распознаванием лиц — за парнем и стрельбой в него с высоты 10 000 футов», — утверждает Палмер Лаки, основатель Anduril, одной из фирм, участвующих в StormCloud. «Речь идет о попытке сбить флот десантных кораблей в Тайваньском проливе». Если объект обладает визуальной, электронной и тепловой сигнатурой ракетной установки, утверждает он, «вы просто не можете ошибаться… Он невероятно уникален». Довоенное моделирование еще больше снижает неопределенность: «99% того, что вы видите в китайском конфликте, будет выполнено в симуляции несколько раз, — говорит Лаки, — задолго до того, как это произойдет».

«Проблема в том, что когда машина совершает ошибки, это ужасные ошибки», — говорит генерал Хейман. «Если они будут приняты, это приведет к травматическим событиям». Поэтому он выступает против того, чтобы выводить человека «из петли» и автоматизировать удары. «Это действительно заманчиво», — признает он. «Вы беспрецедентно ускорите процедуру. Но вы можете нарушить международное право». Лаки признает, что ИИ будет наименее актуален в «грязной, грязной, ужасной» работе городских войн в стиле Газы. «Если люди воображают, что роботы-терминаторы будут искать нужного Мухаммеда и стрелять в него… Так не выйдет».

Со своей стороны, МККК предупреждает, что ИИ-системы потенциально непредсказуемы, непрозрачны и подвержены предвзятости, но признает, что они «могут способствовать более быстрому и широкому сбору и анализу имеющейся информации… минимизация рисков для гражданского населения». Многое зависит от того, как используются инструменты. Если ЦАХАЛ использовал Lavender, как сообщалось, это говорит о том, что проблема заключалась в чрезмерно расширительных правилах ведения боя и небрежности операторов, а не в какой-либо патологии самого программного обеспечения.

В течение многих лет эксперты и дипломаты спорили в Организации Объединенных Наций о том, следует ли ограничивать или запрещать автономные системы вооружений (AWS). Но даже определить их сложно. МККК говорит, что АРМ — это те, которые выбирают цель на основе общего профиля — скажем, любой танк, а не конкретный танк. Это включает в себя многие беспилотники, используемые на Украине. МККК выступает за запрет AWS, которые нацелены на людей или ведут себя непредсказуемо. Британия возражает, что «полностью автономное» оружие — это оружие, которое идентифицирует, выбирает и атакует цели без «соответствующего контексту участия человека», что является гораздо более высокой планкой. Пентагон придерживается аналогичной точки зрения, подчеркивая «надлежащие уровни человеческого суждения».

Определить это, в свою очередь, чертовски сложно. И дело не только в смертельном акте, но и в том, что ему предшествует. Может показаться, что высокоавтономному ударному беспилотнику не хватает человеческого контроля. Но если его поведение хорошо понятно и он используется в районе, где, как известно, есть законные военные цели и нет гражданских лиц, это может создать мало проблем. И наоборот, инструмент, который просто предлагает цели, может показаться более безобидным. Но командиры, которые вручную утверждают отдельные цели, предложенные инструментом, «без когнитивной ясности или осведомленности», как выразилась правозащитная группа Article 36 — другими словами, бездумно нажимая красную кнопку, — отказываются от моральной ответственности перед машиной.

Затруднительное положение, вероятно, усугубится по двум причинам. Одна из них заключается в том, что ИИ порождает ИИ. Если одна армия использует ИИ для более быстрого обнаружения и поражения целей, другая сторона может быть вынуждена обратиться к ИИ, чтобы не отставать. Это уже имеет место, когда речь идет о противовоздушной обороне, где передовое программное обеспечение было необходимо для отслеживания приближающихся угроз с самого начала компьютерной эры.

Другая причина заключается в том, что пользователям будет сложнее понять поведение и ограничения военных систем. Современное машинное обучение пока не получило широкого распространения в «критических» системах поддержки принятия решений, отмечает Холланд Мишель. Эти системы будут выполнять «менее математически определенные задачи», отмечает он, такие как предсказание будущих намерений противника или даже его или ее эмоционального состояния.

Поговаривают даже об использовании ИИ в принятии ядерных решений. Идея заключается в том, что страны могут не только объединять данные для отслеживания поступающих угроз (как это происходило с 1950-х годов), но и автоматически принимать ответные меры, если политическое руководство будет убито в результате первого удара. Советский Союз работал над такой концепцией «мёртвой руки» во время холодной войны в рамках своей системы «Периметр». Он по-прежнему используется и, по слухам, зависит от программного обеспечения, управляемого ИИ, отмечает Леонид Рябихин, бывший офицер советских ВВС и эксперт по контролю над вооружениями. В 2023 году группа американских сенаторов даже внесла новый законопроект: «Закон о блокировании ядерного запуска автономным искусственным интеллектом».Это, естественно, секретная область, и мало что известно о том, как далеко хотят зайти разные страны. Но этот вопрос достаточно важен, чтобы быть одним из главных в повестке дня президентских переговоров в 2023 году между Джо Байденом и Си Цзиньпином.

На данный момент в обычных войнах «почти всегда есть время для того, чтобы кто-то сказал «да» или «нет», говорит британский офицер. «Нет необходимости в автоматизации всей цепочки убийств или подталкивания». Будет ли это правдой в войне высокой интенсивности с Россией или Китаем, менее ясно. В книге «Команда человек-машина», опубликованной под псевдонимом в 2021 году, бригадный генерал Йоси Сариэль, глава элитного подразделения израильской военной разведки, написал, что «человеко-машинная команда» с искусственным интеллектом может генерировать «тысячи новых целей каждый день» в войне. «Существует человеческое узкое место, — утверждал он, — как для определения местоположения новых целей, так и для принятия решений об утверждении целей».

На практике все эти дебаты вытесняются событиями. Ни Россия, ни Украина не обращают особого внимания на то, является ли беспилотник «автономной» системой вооружения или просто «автоматизированной». Их приоритетом является создание оружия, способного уклоняться от помех и уничтожать как можно больше вражеской брони. Ложноположительные результаты не являются большой проблемой ни для российской армии».

Над этими дебатами также нависает призрак войны с участием великих держав. Страны НАТО знают, что им, возможно, придется иметь дело с российской армией, которая, возможно, после окончания этой войны будет иметь большой опыт создания оружия с ИИ и его испытаний на поле боя. Китай также использует многие из тех же технологий, что и Америка. Китайские фирмы производят подавляющее большинство беспилотников, продаваемых в Америке, будь то в качестве потребительских товаров или для промышленных целей. В ежегодном докладе Пентагона о военной мощи Китая отмечается, что в 2022 году Народно-освободительная армия Китая (НОАК) начала обсуждать «многодоменную высокоточную войну»: использование «больших данных и искусственного интеллекта для быстрого выявления ключевых уязвимостей» в американских военных системах, таких как спутники или компьютерные сети, которые затем могут быть атакованы.

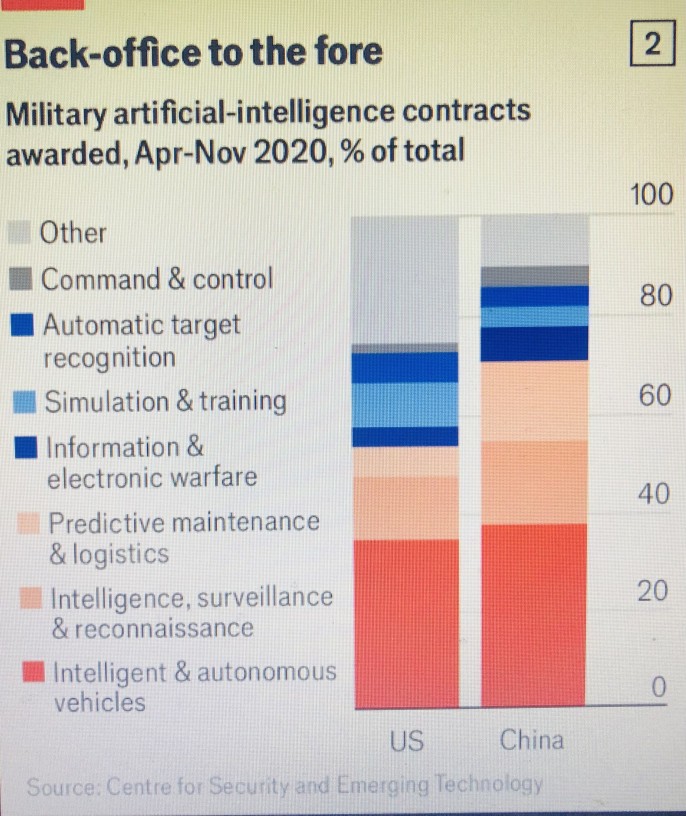

Вопрос в том, кто одержит верх. Американские чиновники когда-то беспокоились о том, что слабые правила конфиденциальности и контроль Китая над частным сектором дадут НОАК доступ к большему количеству и более качественным данным, что приведет к созданию более совершенных алгоритмов и оружия. Эти опасения смягчились. Недавнее исследование данных о закупках, проведенное Центром безопасности и новых технологий (CSET) при Джорджтаунском университете, показало, что Америка и Китай «уделяют сопоставимый уровень внимания аналогичному набору приложений ИИ» (см. диаграмму 2).

Более того, Америка вырвалась вперед в передовых моделях, отчасти благодаря ограничениям на чипы. В 2023 году она произвела 61 примечательную модель машинного обучения, а в Европе — 25, по данным компании Epoch AI. Китай произвел 15. Это не модели в нынешних военных системах, но они будут использоваться в будущем. «Китай сталкивается со значительными препятствиями с… военным ИИ», — утверждает Сэм Бресник из CSET. Он отмечает, что неясно, обладает ли НОАК техническими талантами для создания систем мирового класса, а централизованное принятие решений может препятствовать поддержке принятия решений с помощью ИИ. Многие китайские эксперты также обеспокоены «ненадежным» ИИ. «НОАК обладает большой смертоносной военной мощью, — отмечает Джейкоб Стоукс из CNAS, другого аналитического центра, — но в настоящее время ни одна из них, похоже, не обладает значимым уровнем автономии, обеспечиваемым ИИ».

Кажущаяся медлительность Китая является частью более широкой картины. Некоторые, такие как Кеннет Пейн из Королевского колледжа Лондона, считают, что ИИ изменит не только ведение войны, но и ее сущность. «Это слияние машинно-человеческого интеллекта возвестит о действительно новой эре принятия решений на войне», — предсказывает он. «Возможно, это самое революционное изменение со времен открытия письменности несколько тысяч лет назад». Но даже по мере того, как такие утверждения становятся все более правдоподобными, трансформация во многих отношениях остается упорно далекой.

«Ирония заключается в том, что мы говорим так, как будто ИИ повсюду в обороне, хотя его почти нигде», — отмечает сэр Крис Деверелл, британский генерал в отставке. «Проникновение ИИ в Министерство обороны Великобритании практически нулевое… Здесь много новаторского театра». Высокопоставленный чиновник Пентагона говорит, что министерство добилось серьезного прогресса в улучшении инфраструктуры данных — каналов, по которым перемещаются данные, — и в беспилотных летательных аппаратах, которые работают вместе с боевыми самолетами с экипажами. Тем не менее, Пентагон тратит менее 1% своего бюджета на программное обеспечение — статистика, которую часто приводят руководители оборонно-технологических стартапов. «Уникальность Пентагона заключается в том, что наша миссия включает в себя применение силы, поэтому ставки высоки», — говорит чиновник. «Мы должны внедрять ИИ быстро и безопасно».

Между тем, британский StormCloud становится «все лучше и лучше», говорит офицер, участвующий в его разработке, но проект продвигается медленно из-за внутренней политики и бюрократических проволочек вокруг аккредитации новой технологии. Финансирование второй итерации составило ничтожные 10 миллионов фунтов стерлингов, карманные деньги в мире обороны. В 2024 году планируется использовать его на нескольких учениях. «Если бы мы были на месте Украины или действительно беспокоились о том, что в ближайшее время начнем войну, — говорит офицер, — мы бы потратили более 100 миллионов фунтов стерлингов и развернули бы ее в течение нескольких недель или месяцев».

III. «6 способов, которыми ИИ изменит войну и мир». Так назвал свою статью в Bloomberg (09.06.2024) профессор Хэл Брэндс (Университет Джона Хопкинса). Автор пишет:

«Насколько революционным будет ИИ? Нарушит ли это глобальный баланс сил? Позволит ли это автократиям править миром? Сделает ли это войну настолько быстрой и жестокой, что она станет неконтролируемой? Короче говоря, изменит ли ИИ фундаментально ритмы мировых событий?

Конечно, еще слишком рано говорить однозначно: последствия ИИ в конечном итоге будут зависеть от решений, которые принимают лидеры и страны, а технологии иногда совершают неожиданные повороты. Но даже несмотря на то, что следующая версия ChatGPT нас удивляет и беспокоит, нам нужно разобраться с шестью более глубокими вопросами о международных отношениях в эпоху ИИ. И нам нужно рассмотреть удивительную возможность: возможно, ИИ не изменит мир так сильно, как мы ожидаем.

1) Сделает ли ИИ войну неуправляемой?

Рассмотрим одно утверждение: ИИ сделает конфликт более смертоносным и его будет труднее сдерживать. Аналитики предвидят будущее, в котором машины смогут пилотировать истребители более умело, чем люди, кибератаки с помощью ИИ разрушают вражеские сети, а передовые алгоритмы ускоряют скорость принятия решений. Некоторые предупреждают, что автоматизированное принятие решений может спровоцировать стремительную эскалацию – даже ядерную эскалацию – что заставит политиков задуматься о том, что же произошло. Если военные планы и расписание железных дорог стали причиной Первой мировой войны, возможно, ИИ станет причиной Третьей мировой войны.

То, что ИИ изменит войну, неоспоримо. Возможности огромны: от обеспечения профилактического обслуживания оборудования до поразительных улучшений в области точного нацеливания. Один F-35, защищающий рой полуавтономных дронов, может обладать огневой мощью целого крыла бомбардировщиков. Как заключила в 2021 году Комиссия национальной безопасности по искусственному интеллекту (США), в «новой эпохе конфликта» будет доминировать та сторона, которая освоит «новые способы ведения войны».

Но здесь нет ничего принципиально нового. История войн на протяжении веков — это история, в которой инновации регулярно делают бой более быстрым и интенсивным. Так что подумайте дважды, прежде чем согласиться с утверждением, что ИИ сделает эскалацию неконтролируемой.

США и Китай обсудили соглашение не автоматизировать свои процессы ядерного командования и контроля (обещание, которое Вашингтон дал независимо) по той простой причине, что у государств есть сильные стимулы не отказываться от контроля над оружием, использование которого может поставить под угрозу их собственное выживание. Большую озабоченность вызывает поведение России, включая разработку торпед с ядерным боеголовкой, которые в конечном итоге смогут работать автономно. Но даже во время холодной войны, когда Москва создала систему, призванную обеспечить ядерный ответный удар, даже если ее руководство будет уничтожено, она никогда не отключала человеческий контроль. Ожидайте, что сегодняшние великие державы будут агрессивно использовать военные возможности, которые предоставляет ИИ, пытаясь при этом оставить самые важные решения в руках людей.

Фактически, ИИ может снизить риск головокружительной эскалации, помогая лицам, принимающим решения, сквозь туман кризиса и войны. Пентагон считает, что разведывательные и аналитические инструменты на основе ИИ могут помочь людям разобраться в запутанной или фрагментарной информации о подготовке врага к войне или даже о том, действительно ли ведется опасная ракетная атака».

«В этом смысле ИИ может смягчить неуверенность и страх, которые подталкивают людей к крайним реакциям. Предоставляя политикам лучшее понимание событий, ИИ может также улучшить их способность управлять ими».

2) Поможет ли ИИ автократиям, таким как Китай, контролировать мир?

А как насчет связанного с этим кошмара — что ИИ поможет силам тирании контролировать будущее? Аналитики, такие как Юваль Ноа Харари, предупреждают, что ИИ сократит затраты и увеличит отдачу от репрессий. Разведывательным службам, оснащенным ИИ, потребуется меньше рабочей силы для расшифровки огромных объемов разведывательной информации, которую они собирают о своем населении, что позволит им, например, точно составить карту и безжалостно разрушить сети протестов. Они будут использовать технологию распознавания лиц с поддержкой ИИ для наблюдения и контроля над своими гражданами, одновременно используя созданную ИИ дезинформацию для дискредитации критиков внутри страны и за рубежом. Повышая эффективность автократии, ИИ может позволить диктаторам доминировать в эпоху зари.

Это, безусловно, то, на что надеется Китай. Правительство президента Си Цзиньпина разработало систему «социального кредита», которая использует ИИ, распознавание лиц и большие данные для обеспечения надежности своих граждан, регулируя их доступ ко всему: от кредитов под низкие проценты до билетов на самолет».

«Пекин намерен захватить «стратегические командные высоты» инноваций, поскольку считает, что ИИ может укрепить его внутреннюю систему и военную мощь. Он использует мощь нелиберального государства, чтобы направить деньги и таланты на передовые технологии».

«Верить в то, что ИИ фундаментально поддерживает автократию, значит верить в то, что некоторые из наиболее важных и давних факторов, способствующих инновациям, такие как открытые потоки информации и терпимость к инакомыслию, больше не так важны. Однако автократия уже ограничивает потенциал Китая.

Создание мощных больших языковых моделей требует огромных объемов информации. Но если эти данные будут испорчены или предвзяты из-за жесткой цензуры китайского Интернета, качество результатов пострадает. Все более репрессивная система со временем также будет бороться за привлечение лучших талантов: показательно, что 38% ведущих исследователей ИИ в США родом из Китая. И умные технологии по-прежнему должны использоваться правительственными институтами Китая, которые становятся все менее технократически компетентными — по мере того, как политическая система становится все более централизованно подчиненной».

3) Будет ли ИИ отдавать предпочтение наиболее развитым или остальным обществам?

«Некоторые технологии сокращают разрыв между наиболее и наименее технологически развитыми обществами. Ядерное оружие, например, позволяет таким небольшим странам, как Северная Корея, компенсировать военные и экономические преимущества, которыми обладает сверхдержава и ее союзники. Другие увеличивают разрыв: в ХIХ веке магазинные винтовки, пулеметы и пароходы позволили европейским обществам подчинить себе обширные территории мира.

В некотором смысле ИИ усилит слабых. Официальные лица США обеспокоены тем, что большие языковые модели могут помочь террористам с грубыми научными наборами создать биологическое оружие. Иран сможет использовать ИИ для координации группировок дронов против военных кораблей США в Персидском заливе. Более благоприятным является то, что ИИ может расширить доступ к базовым медицинским услугам на Глобальном Юге, создавая большие выгоды в виде увеличения продолжительности жизни и экономической производительности.

Однако в других отношениях ИИ будет игрой для богатых. Разработка современного ИИ обходится фантастически дорого. Обучение больших языковых моделей может потребовать огромных инвестиций и доступа к ограниченному числу ведущих ученых и инженеров, не говоря уже об ошеломляющих объемах электроэнергии. По некоторым оценкам, стоимость инфраструктуры, поддерживающей чат-бот Microsoft Bing AI, составляет 4 миллиарда долларов. Практически каждый может стать пользователем ИИ, но для того, чтобы стать его создателем, требуются огромные ресурсы.

Вот почему средние державы, делающие большие шаги в области ИИ, такие как Саудовская Аравия и Объединенные Арабские Эмираты, имеют очень глубокие карманы. Многие из первых лидеров в гонке ИИ являются либо технологическими титанами (Alphabet, Microsoft, Meta, IBM, Nvidia и другие), либо фирмами, имеющими доступ к их деньгам (OpenAI). И США, с их динамичным, хорошо финансируемым технологическим сектором, по-прежнему лидируют в этой области.

То, что верно в частном секторе, может быть верно и в сфере ведения войны. На начальном этапе военные выгоды от новых технологий могут в непропорциональной степени достаться странам с щедрыми оборонными бюджетами, необходимыми для разработки и применения новых возможностей в больших масштабах.

Все это может измениться: раннее лидерство не всегда приводит к устойчивым преимуществам. Выскочки, будь то фирмы или страны, уже революционизировали другие области. Однако на данный момент ИИ может скорее укрепить, чем революционизировать баланс сил.

4) Будет ли ИИ разрушать или укреплять коалиции?

То, как ИИ повлияет на баланс сил, зависит от того, как он повлияет на глобальные коалиции. Как зафиксировали аналитики Центра безопасности и новых технологий Джорджтаунского университета, США и их союзники могут значительно опередить Китай в расходах на передовые технологии — но только если они объединят свои ресурсы. Самая большая надежда Пекина заключается в том, что свободный мир расколется из-за ИИ.

Это может случиться. Вашингтон обеспокоен тем, что новый подход Европы к генеративному регулированию ИИ может задушить инновации: в этом смысле ИИ подчеркивает расходящиеся подходы США и Европы к рынкам и рискам. Другая ключевая демократия, Индия, предпочитает стратегическую автономию стратегическому союзу: в технологиях, как и в геополитике, она предпочитает идти своим собственным путем. Тем временем некоторые из недемократических партнеров Вашингтона, а именно Саудовская Аравия и ОАЭ, рассматривают возможность более тесных технологических связей с Пекином.

Но делать вывод о том, что ИИ фундаментально разрушит альянсы США, преждевременно. В некоторых случаях США успешно используют эти альянсы в качестве инструментов технологической конкуренции: посмотрите, как Вашингтон уговаривал Японию и Нидерланды ограничить доступ Китая к высококачественным полупроводникам. США также используют партнерские отношения в области безопасности с Саудовской Аравией и ОАЭ, чтобы ограничить их технологические отношения с Пекином и способствовать партнерству в области ИИ между американскими и эмиратскими фирмами. В этом смысле геополитические расклады определяют развитие ИИ, а не наоборот.

На более фундаментальном уровне предпочтения стран в отношении ИИ связаны с их предпочтениями в отношении внутреннего и международного порядка. Таким образом, какие бы разногласия ни существовали между США и Европой, они могут меркнуть по сравнению с их общими опасениями по поводу того, что произойдет, если Китай достигнет господства. Европа и Америка могут в конечном итоге найти путь к более тесному сотрудничеству по вопросам ИИ — точно так же, как общая враждебность к мощи США подталкивает Китай и Россию к более тесному сотрудничеству в области военного применения этой технологии сегодня.

5) Сможет ли ИИ укротить или разжечь соперничество великих держав?

Многие из этих вопросов связаны с тем, как ИИ повлияет на интенсивность конкуренции между Западом, возглавляемым США, и автократическими державами, возглавляемыми Китаем. Никто на самом деле не знает, может ли безудержный ИИ действительно угрожать человечеству. Но общие экзистенциальные риски иногда становятся странными партнерами.

Во время первой холодной войны США и Советский Союз сотрудничали, чтобы справиться с опасностями, связанными с ядерным оружием. Во время новой холодной войны, возможно, Вашингтон и Пекин найдут общую цель – не допустить использования ИИ в злонамеренных целях, таких как биотерроризм или иным образом угрожать странам по обе стороны сегодняшних геополитических разногласий.

Однако эта аналогия имеет двусторонний характер, поскольку ядерное оружие также сделало холодную войну более острой и страшной. Вашингтону и Москве пришлось пережить столкновение с высокими ставками, такое как Карибский кризис на Кубе и несколько кризисов в Берлине, прежде чем установилась шаткая стабильность. Преимущества одностороннего преимущества настолько заманчивы. Таким образом, даже несмотря на то, что США и Китай начинают зарождающийся диалог в области ИИ, технологии усиливают их конкуренцию.

ИИ находится в центре китайско-американской технологической войны, поскольку Китай использует разные методы для ускорения собственного развития, а США применяют экспортный контроль, ограничения на инвестиции и другие меры, чтобы заблокировать путь Пекина».

«ИИ также подпитывает борьбу за военное превосходство в западной части Тихого океана: «Инициатива репликатора» Пентагона предусматривает использование тысяч дронов с поддержкой ИИ для уничтожения китайского вторжения, направляющегося на Тайвань. Дуэльные державы могут в конечном итоге найти способы сотрудничества, возможно, молчаливого, в отношении взаимных опасностей, которые представляет собой ИИ. Но преобразующая технология в будущем усилит многие аспекты их соперничества».

6) Сделает ли ИИ частный сектор превосходящим государственный?

ИИ, несомненно, изменит баланс влияния между государственным и частным секторами. Аналогии между ИИ и ядерным оружием могут быть поучительны, но только до определенной степени: идея Манхэттенского проекта по ИИ вводит в заблуждение, поскольку это область, где деньги, инновации и таланты в подавляющем большинстве находятся в частном секторе.

Таким образом, компании, работающие в области ИИ, становятся мощными геополитическими игроками — и правительства это знают. Когда Илон Маск и другие эксперты выступали за мораторий на разработку передовых моделей ИИ в 2023 году, официальный Вашингтон призвал технологические компании не останавливаться, потому что это просто поможет Китаю догнать их. Государственная политика может ускорить или замедлить инновации. Но в значительной степени стратегические перспективы Америки зависят от достижений частных фирм.

Важно не заходить в этом аргументе слишком далеко. Гражданско-военное слияние Китая призвано гарантировать, что государство сможет направлять и использовать инновации частного сектора. Хотя США, как демократическая страна, не могут по-настоящему имитировать этот подход, концентрация великой власти в частных компаниях повлечет за собой ответную реакцию правительства.

Вашингтон участвует, хотя и нерешительно, в дебатах о том, как лучше всего регулировать ИИ, чтобы способствовать инновациям, ограничивая при этом вредоносное использование и катастрофические происшествия. Длинная рука государственной власти активна и в других отношениях: США никогда не позволят китайским инвесторам покупать ведущие национальные компании в области ИИ и ограничивают американские инвестиции в сектора ИИ в государствах-соперниках. А когда банк Кремниевой долины, владевший депозитами многих фирм и инвесторов в технологическом секторе, стремительно приближался к неплатежеспособности, геополитические проблемы помогли инициировать правительственную помощь.

Следует также ожидать, что в ближайшие годы больший акцент будет сделан на оказании помощи Пентагону в стимулировании разработки технологий, имеющих отношение к военной сфере, а также на облегчении превращения инноваций частного сектора в оружие, позволяющее выиграть войну. Чем более стратегически важным будет ИИ, тем менее правительства будут готовы просто позволить рынку делать свою работу.

Мы не можем предсказать будущее: ИИ может зайти в тупик или ускориться, превзойдя все ожидания. Более того, технология не является какой-то автономной силой. Его развитие и последствия будут определяться решениями во всем мире».